Cơn sốt xây dựng cơ sở hạ tầng AI đang tiếp diễn với tốc độ chóng mặt.

Đối với các nhà đầu tư công nghệ, năm 2025 bắt đầu bằng một sự hoảng loạn.

Một mô hình AI mới siêu hiệu quả từ nhà phát triển Trung Quốc DeepSeek khiến Phố Wall đặt câu hỏi liệu các công ty công nghệ lớn và các công ty khởi nghiệp ở Thung lũng Silicon có đang chi tiêu quá mức cho các trung tâm dữ liệu mới khổng lồ.

Sáu tháng sau, những lo lắng đó dường như chỉ là thoáng qua. Cơn sốt xây dựng cơ sở hạ tầng AI vẫn tiếp diễn với tốc độ chóng mặt.

Microsoft, Alphabet, Amazon và Meta có kế hoạch tăng chi tiêu vốn lên hơn 300 tỷ USD vào năm 2025. Công ty tư vấn CNTT Gartner ước tính tổng cộng 475 tỷ USD sẽ được chi cho các trung tâm dữ liệu trong năm nay, tăng 42% so với năm 2024.

Một số người tin rằng ngay cả con số đó cũng không đủ để đáp ứng nhu cầu toàn cầu về AI. McKinsey dự đoán vào tháng 4 rằng đến năm 2030, sẽ cần 5,2 nghìn tỷ USD đầu tư vào các trung tâm dữ liệu.

Đầu tháng này, nhà sáng lập Meta, Mark Zuckerberg, công bố rằng công ty của ông đang đầu tư hàng trăm tỷ USD vào điện toán để xây dựng siêu trí tuệ, ám chỉ những nỗ lực vượt qua nhận thức của con người. Khoản đầu tư này sẽ được dành cho các cụm trung tâm dữ liệu – một cụm có diện tích đủ lớn để bao phủ hầu hết Manhattan. Ông cũng đang lên kế hoạch cho các cụm khác, mỗi cụm được đặt theo tên của các vị thần Titan trong thần thoại Hy Lạp.

“Tôi không biết bất kỳ công ty, ngành công nghiệp hay quốc gia nào cho rằng trí tuệ nhân tạo là tùy chọn — Nó chính xác là cơ sở hạ tầng thiết yếu”, Jensen Huang, giám đốc điều hành của Nvidia, phát biểu vào tháng 5. “Rõ ràng chúng ta đang ở giai đoạn đầu của việc xây dựng cơ sở hạ tầng”.

Tuy nhiên, việc xây dựng các cơ sở cần thiết để theo đuổi mục tiêu tiếp theo này tốn kém hơn và tiêu tốn năng lượng hơn so với lưới điện, mạng viễn thông hoặc thậm chí là hệ thống điện toán đám mây trước đây. Andy Lawrence, giám đốc điều hành nghiên cứu tại Uptime Institute, đơn vị kiểm tra và đánh giá các trung tâm dữ liệu, cho biết: “Các trung tâm dữ liệu truyền thống, chẳng hạn như những trung tâm được xây dựng bởi Amazon và Microsoft, là một mô hình đã được chứng minh với lợi nhuận đã được chứng minh và nhu cầu đã được chứng minh”.

Ông cho biết: “Việc đột nhiên bắt đầu xây dựng các trung tâm dữ liệu có mật độ sử dụng điện năng dày đặc hơn nhiều, chi phí chip cao gấp 10 lần, nhu cầu chưa được chứng minh và ngốn hết điện lưới hiện có cũng như diện tích đất phù hợp – tất cả những điều này đều là một thách thức to lớn và là một canh bạc” .

Nhu cầu điện năng tăng mạnh từ các chip AI mới đã làm thay đổi thiết kế trung tâm dữ liệu. Các giá máy tính chạy chip Nvidia tiêu thụ ít nhất 10 lần điện năng so với các máy chủ web thông thường. Bộ xử lý mới nhất của hãng này tỏa ra nhiều nhiệt đến mức điều hòa không khí không đủ để làm mát.

“Mọi thứ đã bị đảo lộn hoàn toàn”, Steven Carlini, phó chủ tịch phụ trách đổi mới và trung tâm dữ liệu tại Schneider Electric, nhà cung cấp cơ sở hạ tầng điện hàng đầu cho các trung tâm dữ liệu, cho biết.

Các cơ sở thông thường chứa đầy các hàng máy chủ chiếm phần lớn diện tích sàn, nhưng hiện nay “70% diện tích nằm ngoài phòng CNTT”, Carlini nói thêm.

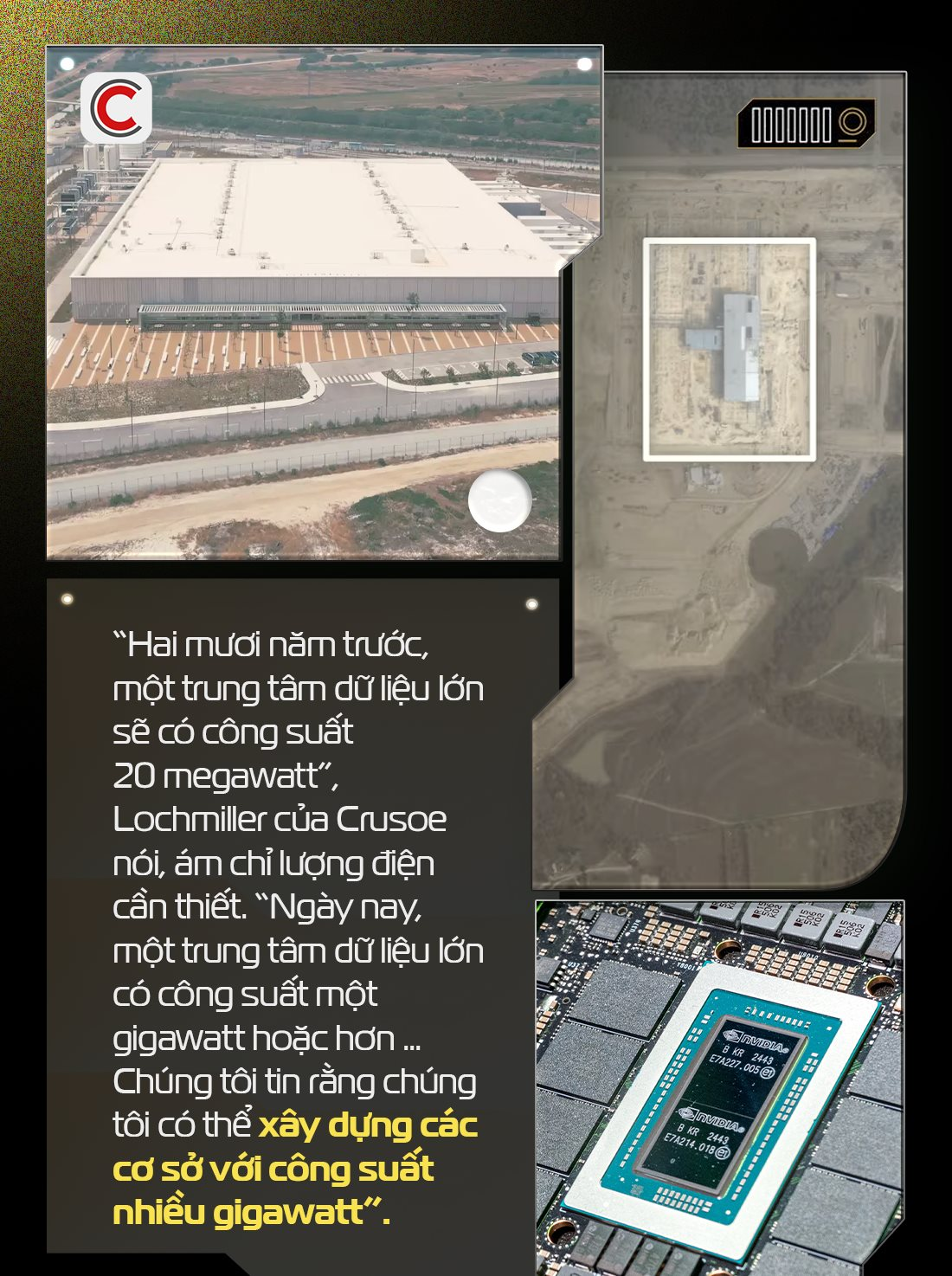

“Hai mươi năm trước, một trung tâm dữ liệu lớn sẽ có công suất 20 megawatt”, Lochmiller của Crusoe nói, ám chỉ lượng điện cần thiết. “Ngày nay, một trung tâm dữ liệu lớn có công suất một gigawatt hoặc hơn … Chúng tôi tin rằng chúng tôi có thể xây dựng các cơ sở với công suất nhiều gigawatt”.

AI đang định hình lại cách thức xây dựng cơ sở hạ tầng điện toán, đến mức Meta đã phá bỏ một trung tâm dữ liệu vẫn đang trong quá trình phát triển và thiết kế lại để lắp đặt chip mạnh hơn. Hình ảnh vệ tinh cho thấy vào năm 2023, công ty tạo ra mô hình AI Llama này đã phá dỡ các công trình xây dựng tại một địa điểm ở Texas trước khi khởi động lại việc xây dựng như một phần của chiến lược đại tu cơ sở hạ tầng rộng lớn.

Đằng sau sự chuyển đổi là làn sóng dịch chuyển toàn diện khỏi các loại chip đã cung cấp năng lượng cho phần lớn máy tính cá nhân và máy chủ trong nhiều thập kỷ. Hầu hết máy tính cá nhân trong những năm 1990 và 2000 chủ yếu dựa vào bộ xử lý trung tâm, với một dàn tùy chọn hỗ trợ gồm bộ tăng tốc đồ họa và card âm thanh để chơi game hoặc tạo nhạc. Khi điện toán đám mây phát triển mạnh mẽ vào những năm 2010, Amazon Web Services và cơ sở hạ tầng cung cấp năng lượng cho các dịch vụ internet của Google hoặc Facebook rất giống với những máy tính sử dụng CPU phổ thông đó.

Cơ sở hạ tầng AI ngày nay được xây dựng xung quanh một thế hệ kế thừa của card đồ họa. Bộ xử lý đồ họa (GPU) của Nvidia đã trở thành thành phần chủ chốt của một trung tâm dữ liệu hiện đại nhờ khả năng xử lý lượng dữ liệu khổng lồ song song — tương tự như cách chúng giúp trò chơi điện tử chạy mượt mà hơn.

Cuộc tìm kiếm không ngừng nghỉ về sức mạnh tính toán đang thúc đẩy sự bùng nổ bất động sản. Các nhà cung cấp dịch vụ đám mây lớn bao gồm Amazon, Microsoft và Google đang phát triển các cụm trung tâm dữ liệu để hàng trăm nghìn con chip có thể hoạt động phối hợp nhằm tinh chỉnh các mô hình AI. Một trong những cụm đầu tiên được phát triển tại Mỹ nằm ở phía bắc Virginia, được ngành công nghiệp gọi là “Data Center Alley”.

Giá đất rẻ, ưu đãi thuế và quyền truy cập vào hệ thống cáp ngầm nối liền Bắc Mỹ và Châu Âu đã khiến tiểu bang này trở thành điểm thu hút đối với các công ty công nghệ lớn. Virginia, nơi có công suất khoảng 9,6GW, cũng là khu vực được để ý.

Các cụm mới xuất hiện ở các khu vực như Atlanta, Columbus, Dallas và Phoenix, nơi chi phí năng lượng thấp hơn và việc lắp đặt cáp quang cho phép xây dựng nhanh chóng. Kevin Miller, cựu phó chủ tịch trung tâm dữ liệu toàn cầu tại Amazon Web Services, cho biết: “Việc đào tạo thực sự tập trung vào các cụm lớn, nơi bạn cần càng nhiều GPU và bộ tăng tốc càng tốt, trong phạm vi gần nhất có thể. Khoảng cách gần nhất về mặt vật lý giúp giảm độ trễ, từ đó cải thiện tốc độ đào tạo các mô hình mới”.

Số lượng lớn chip được triển khai bởi các nhà xây dựng mô hình như OpenAI và Anthropic đã khiến các công ty siêu quy mô và nhà điều hành trung tâm dữ liệu, bao gồm QTS và Equinix, phải săn lùng những lô đất lớn có thể lưu trữ các cụm. Crusoe đang xây dựng tám tòa nhà trung tâm dữ liệu, với tổng công suất 1,2 GW, tại Abilene, Texas, cho OpenAI; trong khi Oracle sẽ cung cấp khoảng 400.000 GPU Nvidia với chi phí khoảng 40 tỷ USD.

Gã khổng lồ truyền thông xã hội Meta đang xây dựng một cơ sở 2GW tại Richland, Louisiana, trong khi xAI của Elon Musk đang nhắm đến mục tiêu 1,2GW tại nhiều địa điểm ở Memphis, Tennessee. Amazon cũng đang phát triển một cơ sở 2,2GW cho Anthropic tại New Carlisle, Indiana.

Người đứng đầu một quỹ đầu tư ủng hộ Crusoe cho biết số lượng dự án xây dựng trung tâm dữ liệu đã đạt đến mức chóng mặt, với tâm lý “cứ xây đi rồi sẽ có người đến”. Việc xây dựng các cơ sở này ở gần nhau tạo ra hiệu ứng, với lực lượng lao động địa phương được đào tạo bài bản có thể lặp lại các dự án xây dựng tại các địa điểm lân cận.

Khả năng tiếp cận nguồn năng lượng giá rẻ và dồi dào đã trở thành yếu tố then chốt để xác định vị trí đặt nhà máy, đặc biệt là khi nhiều nhà khai thác đang gặp khó khăn về nguồn điện. “Chúng tôi ưu tiên năng lượng và điện năng lên hàng đầu”, Bobby Hollis, Phó Chủ tịch phụ trách năng lượng của Microsoft, cho biết.

Nỗ lực mở rộng cơ sở hạ tầng điện toán AI và sự bùng nổ AI của Trung Quốc đã thúc đẩy chính quyền địa phương xây dựng các trung tâm dữ liệu. Sau khi Bắc Kinh và Mỹ đạt được thỏa thuận hòa hoãn, Nvidia dự kiến sẽ tiếp tục xuất khẩu chip AI sang Trung Quốc. Tuy nhiên, Mỹ vẫn áp dụng các biện pháp kiểm soát xuất khẩu, ngăn chặn việc bán các chất bán dẫn AI mạnh nhất cho thị trường Trung Quốc.

Nhu cầu năng lượng tăng cao là mối lo ngại đối với các nhà cung cấp dịch vụ tiện ích. Bên cạnh việc đòi hỏi lượng điện năng khổng lồ và hoạt động ở tốc độ gần như không đổi, các trung tâm dữ liệu AI phải chịu áp lực tăng đột biến trong quá trình đào tạo do công suất xử lý khổng lồ. Điều này có thể gây ra tình trạng mất điện lan rộng, ảnh hưởng đến các hộ gia đình và doanh nghiệp sử dụng cùng một mạng lưới điện.

Mùa hè năm ngoái, các nhà cung cấp dịch vụ tiện ích ở Virginia đã phải vật lộn với tình trạng điện tăng đột biến sau khi một nhóm cơ sở chuyển sang sử dụng máy phát điện dự phòng để phòng ngừa an toàn, dẫn đến tình trạng dư thừa nguồn cung, gây nguy hiểm cho cơ sở hạ tầng lưới điện.

Theo các nhà nghiên cứu tại LBNL, các địa điểm siêu quy mô và đồng đặt máy chủ tại Mỹ đã tiêu thụ 55 tỷ lít nước vào năm 2023. Mức tiêu thụ gián tiếp liên quan đến sử dụng năng lượng cao hơn đáng kể, tương đương với lượng nước sử dụng hàng năm của gần 2 triệu hộ gia đình tại Mỹ.

Năm 2023, Microsoft cho biết 42% lượng nước của họ đến từ các khu vực đang gặp khó khăn về nước, trong khi Meta cho biết khoảng 16% lượng nước sử dụng của họ đến từ các khu vực tương tự trong cùng kỳ. Google cho biết năm ngoái, gần 30% lượng nước của họ đến từ các lưu vực có nguy cơ cạn kiệt hoặc khan hiếm nước ở mức trung bình hoặc cao.

Các trung tâm dữ liệu ở các tiểu bang dễ bị hạn hán như Arizona và Texas đã gây ra mối lo ngại cho người dân địa phương. Một số người tin rằng cuộc chạy đua bất tận để có sức mạnh tính toán ngày càng lớn là không đúng đắn.

Theo: Financial Times

Theo

markettimes.vn

Copy link

Lấy link

Thể Thao

Zubimendi rực sáng, Arsenal thắng ‘ba sao’

Th9

Công Nghệ

Zalo thu phí zCloud trên iPhone đắt hơn Android, người dùng hỏi tại sao vậy?

Th8

Công Nghệ

Zalo ra thông báo quan trọng tới hàng chục triệu người dùng: Ai cũng nên cập nhật sớm, tránh mất quyền lợi

Th8

Công Nghệ

Zalo ra thông báo mới nhất: Tất cả công dân Việt Nam cần cập nhật ngay để không bị mất quyền lợi

Th9

Công Nghệ

Zalo có thay đổi mới, người dùng cần biết kẻo mất quyền lợi

Th8

Công Nghệ

Zalo cán mốc 78,3 triệu người dùng, đặt Viettel, VNPT, MobiFone trước ‘bẫy đường ống’

Th9

Thể Thao

Yu Zidi, thần đồng Trung Quốc 12 tuổi thay đổi bơi lội thế giới

Th8

Công Nghệ

YouTube triển khai AI xác minh độ tuổi người dùng từ tháng 8/2025

Th8

Công Nghệ

YouTube thử nghiệm AI tự chỉnh sửa video của người dùng

Th9

Công Nghệ

YouTube tặng 2 tháng Premium cho người dùng với 1 điều kiện

Th9

Công Nghệ

YouTube khai tử mục Thịnh hành

Th7

Công Nghệ

YouTube hạn chế việc dùng chung gói Premium Family

Th9

Công Nghệ

YouTube đã tiếp cận hơn 55 triệu người dùng từ 18 tuổi trở lên tại Việt Nam

Th8

Công Nghệ

YouTube bắt đầu “càn quét” tài khoản chia sẻ Premium Family không hợp lệ

Th9

Radio My

Yêu thương cho đi

Th9

Radio My

Yêu say đắm 2 năm, chàng trai ‘bỏ chạy’ sau 3 tháng sống thử

Th8

Radio My

Yêu người khác khi đang ly thân, có bị xem là ngoại tình?

Th9

Radio My

Yêu lại từ đầu

Th9

Radio My

Yêu cô gái 1m2, chàng trai Thanh Hóa vượt 1.300km về ở rể và cái kết

Th9

Thời Sự

Yêu cầu kiểm điểm vụ đề xuất lấy biệt thự trong di tích làm chỗ ở cho Phó giám đốc Sở

Th8

Thời Sự

Yên Bài: Vững bước phát triển, khẳng định vị thế sau sáp nhập

Th8

Công Nghệ

YBY1 lập kỳ tích vô địch cả hai hạng mục tại Đấu Trường Hỗn Chiến Mùa 2

Th8

Thể Thao

Yamal tỏa sáng, Barca đánh bại Mallorca ở vòng 1 La Liga 2025-2026

Th8

Thể Thao

Yamal lập cú đúp mừng áo số 10, Barca thắng to

Th8

Thể Thao

Yamal lập công, Barca ra quân tưng bừng nhờ…trọng tài

Th8

Thể Thao

Yamal khiến đối thủ đốt đền, Barca thoát hiểm phút bù giờ

Th8

Thể Thao

Yamal ghi bàn trong tình huống gây tranh cãi, Barcelona vẫn đứt mạch toàn thắng

Th9

Thể Thao

Yamal chói sáng, Barca đoạt cúp Joan Gamper

Th8

Thời Sự

Ý thức của người dân có chuyển biến tích cực

Th8

Ẩm Thực

Xuýt xoa cá hấp mắm gừng thơm lừng góc bếp

Th8

Thời Sự

Xuyên đêm đưa chuyên cơ từng chở Bác Hồ sang Triển lãm quốc gia

Th8

Thời Sự

Xưởng mất điện cả ngày bỗng cháy đỏ rực trong đêm, khói bốc cao hàng chục mét

Th8

Thời Sự

Xứng đáng với trọng trách, tạo dấu ấn đặc biệt trong lòng Nhân dân

Th9

Giải Trí

Xúc động ước nguyện tuổi 80 của NSND Bạch Tuyết

Th8

Giải Trí

Xúc động ngắm nhìn hình ảnh ‘Những người con của Tổ quốc’

Th8

Radio My

Xúc động lời dặn của bố chồng tương lai, cô gái vượt 1.200km về Nghệ An làm dâu

Th8

Thời Sự

Xúc động lễ chia tay thầy Lê Bá Khánh Trình, 4 tiến sĩ đàn hát ‘Thời thanh niên sôi nổi’

Th8

Thời Sự

Xúc động khoảnh khắc các biên đội trực thăng kéo cờ Đảng, cờ Tổ quốc bay trên Quảng trường Ba Đình

Th8

Thời Sự

Xúc động hình ảnh hàng trăm giáo viên tình nguyện đến vùng lũ dọn dẹp trường lớp

Th8

Giải Trí

Xúc động hàng triệu người hòa giọng Quốc ca trong ngày 2/9

Th9

Radio My

Xúc động cha già gánh gần 80kg đặc sản, vượt hơn 600km đến thăm con cháu

Th9

Công Nghệ

Xuất hiện iPhone 17 Pro nhái chạy Android: Thiết kế y hệt, cũng có Dynamic Island nhưng nhìn là biết hàng “đểu”

Th8

Thể Thao

Xuất hiện đội bóng Anh giải cứu Hojlund, MU reo vui

Th8

Thời Sự

Xuất hiện ‘hố tử thần’ trên quốc lộ nối Quảng Ngãi – Đà Nẵng

Th8

Thể Thao

Xuân Son, Duy Mạnh có hành động ý nghĩa trong ngày 2/9

Th9

Thể Thao

Xuân Son trở lại Việt Nam, báo tin cực vui với HLV Kim Sang Sik

Th9

Thể Thao

Xuân Son lỡ lượt đi V-League, Siêu Cúp Quốc gia nóng rực

Th8

Thể Thao

Xuân Son bất ngờ ‘diện’ áo đội bóng nhà giàu Saudi Arabia

Th8

Sức Khỏe

Xử trí ra sao nếu bị cô lập trong mưa bão?

Th8

Thời Sự

Xử phạt thanh niên lái ôtô mui trần kéo theo xe điện trên phố

Th8

Thông Tin Tiêu Dùng

Người xưa dặn 3 thứ này dù thích cũng không được mang về nhà

Th9

Thông Tin Tiêu Dùng

3 loại cây hợp cả 5 mệnh, cực tốt cho gia đình nhiều người xung khắc, trồng trong nhà vừa đẹp vừa giàu

Th9

Thông Tin Tiêu Dùng

Cô hồn lùi xa, tháng 8 âm lịch tới hãy làm việc này để đón tài lộc, vận may khởi sắc

Th9

Thông Tin Tiêu Dùng

Tháng 7 dọn dẹp nhà cửa rất tốt nhưng phải tránh 3 điều này kẻo đại kỵ phong thủy làm hao tài tổn lộc

Th8

Sức Khỏe

‘Bất lực’, không thể ‘chiều’ vợ chỉ vì uống 1 thứ để bồi bổ

Th8

Thông Tin Tiêu Dùng

‘Bất ngờ Vĩnh Long’ từ cuộc thi ‘Chuyện của những dòng sông’

Th9

Thời Sự

‘Bí mật’ bên trong chiếc túi màu nâu sẫm bỏ quên giữa trưa ở sân bay Nội Bài

Th8

Giải Trí

‘Biểu tượng thiền ca huyền thoại’ đến Việt Nam trình diễn cùng Trần Mạnh Tuấn

Th9